Článek

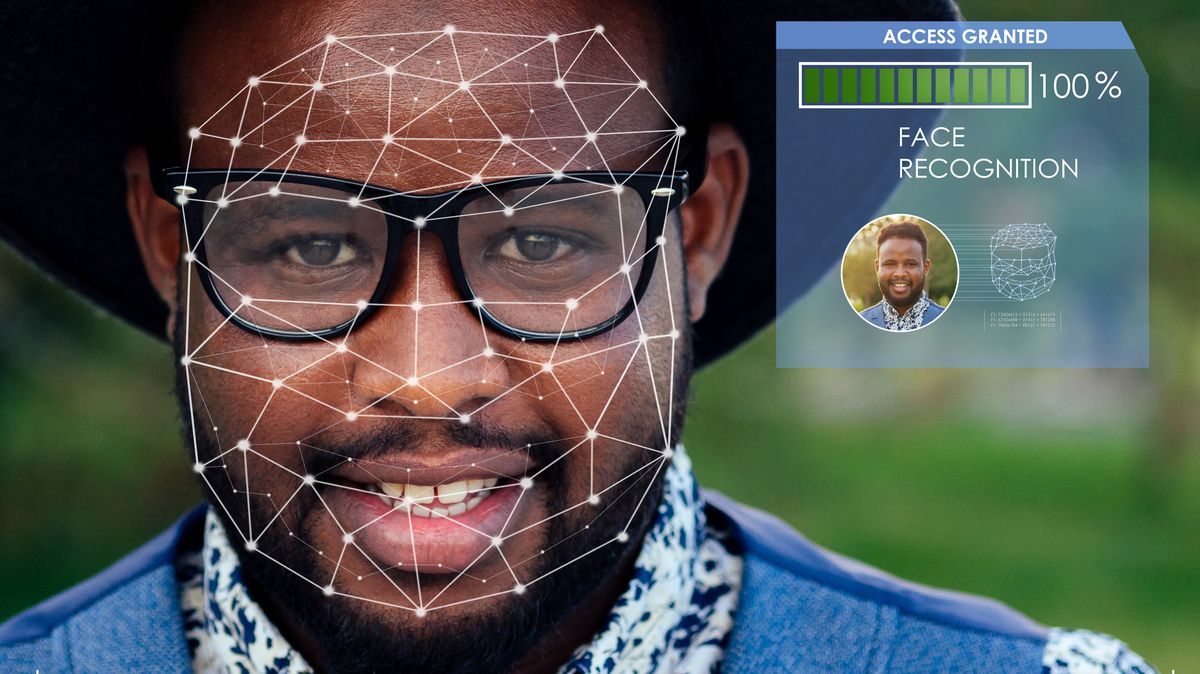

Systém totiž podle několika nezávislých studií funguje špatně. Jak se podrobně vysvětluje a dokazuje v otevřeném dopise, software neumí správně rozeznat ženy a lidi s tmavou barvou pleti. Respektované studie uvádějí, že rozdíl mezi tím, jak jsou současné systémy automaticky identifikující lidi schopné bezpečně rozpoznat identitu bělocha či černocha, je zhruba třetinový.

Autoři výzvy se obávají, že by chybující technologie v kombinaci s využitím orgány činnými v trestním řízení mohla posílit rasovou diskriminaci, vést k případům záměny identit, tudíž ve finále i k justičním omylům v neprospěch minorit.

Čím je to způsobeno? Důležitou roli hraje, jak se umělá inteligence své dovednosti učí. Protože mezi vývojáři převažují bílí muži, je pravděpodobné, že z větší míry učí umělou inteligenci rozpoznávat obličeje právě na bílých mužích. Tím se (možná nevědomě) dopouštějí předpojatosti.

V širším pohledu na problematiku se nabízí i další rizika spojená s tím, že umělá inteligence některé skupiny lidí vnímá hůře. Například ve spojení se samořiditelnými automobily.

Představte si tuto situaci: automobil se blíží k přechodu pro chodce a na něj náhle vstoupí muž bílé pleti a z druhé strany ženy tmavé pleti. A tady sehraje zmíněná třetinová neschopnost rozeznat ženy a lidi tmavé pleti smrtící roli. Stroj prostě ženu neuvidí a rozhodne se jet místem, kudy právě prochází.

V Seattlu, kde sídlí Amazon, natáčel reportér Seznam Zpráv Pavel Cyprich. A na vlastní kůži – přesněji obličej – vyzkoušel – jak fungují současné systémy na rozpoznávání osob. Jeho reportáž můžete vidět ve videu v úvodu článku.

„Rasistické“ rozpoznávání obličejů ale není zdaleka první etický problém, o kterém se v technologickém světě v souvislosti s umělou inteligencí hovoří. Rozruch například vyvolal Google, když loni v květnu představil funkci Duplex pro svého asistenta. Ten lidským hlasem záměrně napodobujícím i řečové nedokonalosti sám v demonstrační ukázce zavolal kvůli rezervaci do restaurace a kadeřnictví.

Hlas svou přirozeností dokonale zmátl člověka na druhé straně linky. Zároveň ale hned vyvstaly otázky ohledně zneužitelnosti technologie k záměrnému klamání lidí. Například reportérka serveru TechCrunch Natasha Lomasová při té příležitosti kritizovala to, jak je u podobného vývoje etika kladena až na druhé místo.

Právě kvůli podobným případům americká technologická společnost Google minulý týden zřídila speciální poradní komisi pro etické otázky umělé inteligence. Ta měla ale vskutku krátké trvání, když ji Google ve čtvrtek rozpustil kvůli kontroverzím ohledně dvou jejích členů.

„Je jasné, že v současném prostředí nemůže ATEAC fungovat tak, jak jsme chtěli. Takže komisi rušíme a vracíme se na začátek,“ uvedl ve čtvrtek zástupce společnosti Google v e-mailu agentuře Reuters.

Portál Vox uvedl, že zaměstnanci Googlu podepsali petici požadující odvolání Kay Colesové Jamesové kvůli poznámkám o transsexuálních osobách. Dalším problémem je členství manažerky ze společnosti vyrábějící drony Dyan Gibbensové, které vyvolalo debatu o použití umělé inteligence Googlu pro vojenské účely.

Komisi tvořili behaviorální ekonom Alessandro Acquisti, expert na aplikovanou a výpočetní matematiku Bubacarr Bah, odborník na strojové učení De Kai, specialistka na automatické systémy Dyan Gibbensová, odbornice na psychologii a umělou inteligenci Joanna Brysonová, Kay Colesová Jamesová, která se věnuje minimalizaci vlády a osobní svobodě, filozof se zaměřením na digitální etiku Luciano Floridi a diplomat William Joseph Burns.