Článek

Analýzu si také můžete poslechnout v audioverzi.

Dlouhé texty na míru, reálně znějící výmysly, realistické obrázky nebo vtipná videa… To všechno lidem poslední tři roky vyrábí generativní AI. Často zdarma, nebo za malý měsíční poplatek. S vygenerovaným obsahem se lidé setkávají stále častěji.

„Často jsou lidé zvědaví, kolik energie ChatGPT spotřebuje na jeden dotaz,“ napsal Sam Altman. Vede firmu OpenAI, která nejpopulárnější AI chatbot provozuje. „Průměrný dotaz spotřebuje 0,34 watthodin, což je přibližně energie, kterou si vezme horkovzdušná trouba za jednu sekundu. A také 0,3 mililitrů vody, což je asi patnáctina čajové lžičky.“

Je to konkrétní příspěvek do důležité debaty. Trochu ale skrývá skutečné dopady. O tom, kolik elektrické energie AI spotřebuje, panuje celá řada omylů. Pojďme se tedy podívat na to, co skutečně víme a co z toho můžeme dovodit.

Zanedbatelná troška?

Altmanova poznámka působí uklidňujícím dojmem. Na první pohled je v protikladu k varovným zprávám o ohromných nárocích AI. Třetina watthodiny? To je přece v moři každodenní spotřeby naprosto zanedbatelná kapička.

Altman ale mluví o jednom průměrném dotazu na ChatGPT. To samo o sobě nic neříká o celkovém dopadu. Ten naopak může být významný.

Představitelé technických firem mluví o tom, že umělá inteligence bude vyžadovat větší a větší podíl elektrické energie. „Do konce dekády by datacentra pohánějící umělou inteligenci mohla spotřebovat 20 % nebo 25 % veškeré energie, která se v USA vyrobí,“ uvedl v roce 2024 Rene Haas, šéf firmy ARM, která vyrábí počítačové čipy. „Dnes to jsou sotva čtyři procenta.“ Jiné odhady jsou konzervativnější a mluví o 9 až 10 procentech.

Velké firmy už kvůli tomu otevírají dříve zavřené jaderné elektrárny. Ale i to je málo. Eric Schmidt, bývalý šéf Google, to v projevu před sněmovní komisí shrnul jednoznačně: „Ze všeho nejvíce potřebujeme energii. Ať už z obnovitelných, nebo jiných zdrojů. Potřebujeme ji rychle. Firmy nyní plánují datacentra se spotřebou 10 gigawattů. Průměrná atomová elektrárna produkuje jeden gigawatt.“

Výroky Altmana i Schimdta ale nejsou v protikladu, paradoxně se doplňují. Provoz umělé inteligence zlevňuje a jeho energetická náročnost klesá. A proto bude poptávka stoupat a celkový dopad tak bude ještě násobně větší než dnes. „Cena umělé inteligence se přiblíží ceně elektrické energie,“ říká doslova Altman.

Pod kapotou umělé inteligence

Běh umělé inteligence se odehrává hlavně v datových centrech. Hlavní tíhu práce nesou grafické procesory (GPU). V těchto specializovaných čipech – původně využívaných hlavně pro počítačové hry – probíhá souběžně velké množství výpočtů. Výkon je vykoupen vysokou spotřebou energie a produkcí množství tepla.

Lídrem trhu je zde jednoznačně společnost Nvidia se svými modely, jako je populární H100.

Kromě GPU vyžadují energii i podpůrné procesory (CPU), které jim servírují data. A také gigantické chladicí systémy, které brání přehřátí. To je ta zmíněná „patnáctina lžičky vody“.

Jak změřit spotřebu AI modelů?

Snaha zjistit, kolik přesně stojí jeden dotaz, naráží na jednu zásadní překážku: hradbu mlčení největších hráčů. Komerční modely jako ChatGPT, Gemini od Googlu nebo Claude od firmy Anthropic fungují jako pověstné černé skříňky. Jejich tvůrci si přesné detaily o architektuře a spotřebě pečlivě střeží. Považují je za cenné obchodní tajemství a pravděpodobně se také obávají negativní publicity, kterou by konkrétní čísla mohla vyvolat. Jak tedy můžeme energetický apetit AI vůbec měřit?

Technologičtí giganti o konkrétních číslech spotřeby mlčí jako hrob. Díky práci výzkumníků, kteří zkoumají otevřené modely, můžeme konečně nahlédnout do strojovny umělé inteligence a pokusit se změřit cenu jednotlivých úkonů.

Odpověď za sekundu, uvažování v minutách

Začněme u textu. Tabulka Michiganské univerzity dokládá, že i v tak obyčejné úloze jsou mezi modely obrovské rozdíly. Malý model (Llama 3.1 8B) si na vygenerování jedné odpovědi vezme jen asi 100 joulů (hodnoty uvádíme po zdvojnásobení spotřeby GPU, aby byla započtena celková energie, pozn. red.).

Pro ty, kdo platí účty za elektřinu: 1 kilowatthodina stojí přibližně pět korun a odpovídá 3 600 000 joulů. Takže 100 joulů by stačilo na pár sekund provozu LED žárovky. Museli byste položit sto tisíc takových dotazů, abyste se dostali na elektřinu v hodnotě dvou korun.

Ovšem větší modely jsou řádově náročnější. V případě modelu Llama 3.1 405B jedna odpověď vyjde celkem na 6700 joulů. Pořád to není mnoho, ale žárovku už by to rozsvítilo na tři minuty.

Spotřebu ovlivňuje i složitost úkolu. Na jednoduché je zapotřebí několikanásobně méně energie než na komplikovanější. Model musí pracovat déle. Spotřeba energie na jednu odpověď je tedy průměr z širokého spektra.

Přemýšlení je ještě stokrát dražší

Velké jazykové modely začnou – slovo po slovu – ihned po položení otázky chrlit odpověď. To se někdy hodí, jindy to ale může vést k chybám a tzv. halucinacím. Novější modely, například o3 od OpenAI nebo Gemini 2.5 od Google, proto odpověď napřed promyslí, pak teprve ukážou výsledek.

V praxi to znamená, že model vede jakýsi vnitřní dialog, rozebírá různé možné postupy a zkouší různé alternativy. Často také může pracovat s nástroji, třeba si něco najít na internetu nebo použít externí kalkulačku. Někdy se tak odpověď uvažujícího (reasoning - pozn. red.) modelu podobá spíše práci AI agenta. Teprve když si je model jistý, že má uživateli co nabídnout, začne generovat výslednou odpověď.

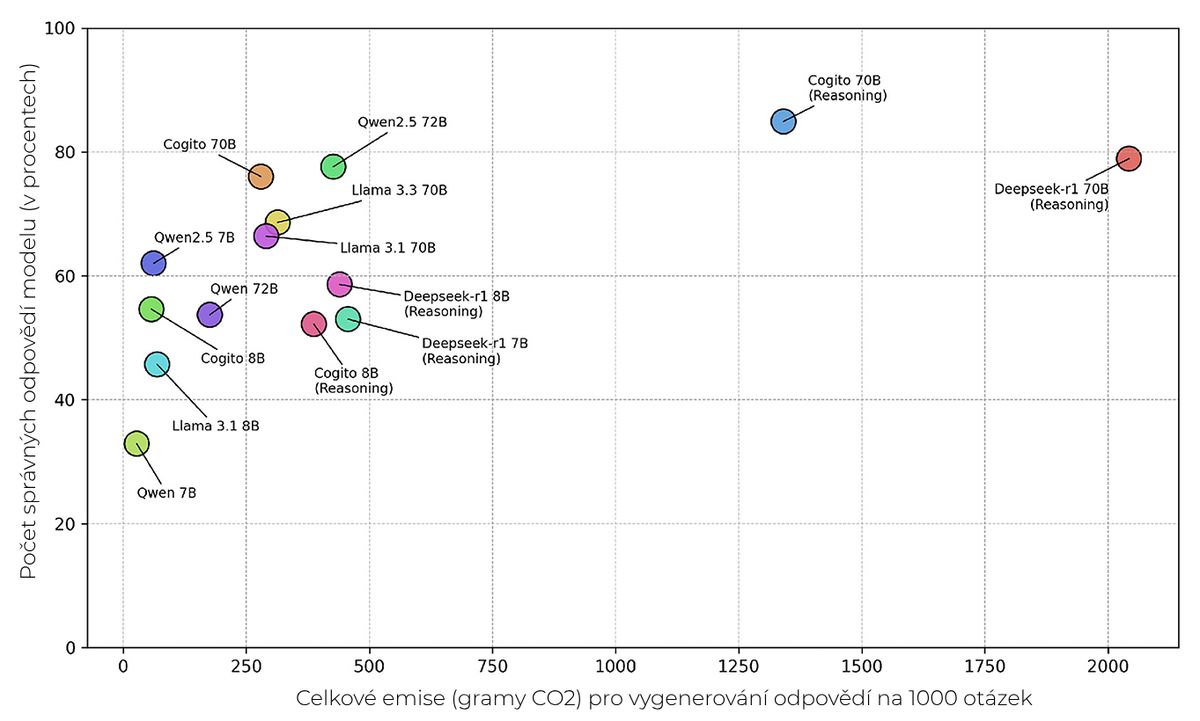

Nedávná studie německých výzkumníků ukázala, že tito „uvažovači“ sice nabízejí přesnější odpovědi, ale je to vykoupeno výrazně vyšší spotřebou energie.

Nejvyšší přesnosti (přes 84 %) dosáhl uvažující model Cogito 70B, ovšem jeho spotřeba byla oproti neuvažující variantě Cogito 70B přibližně pětinásobná.

Kromě velkých jazykových modelů existují i „malé velké jazykové modely“, které jsou přizpůsobené pro běh například na mobilním telefonu. Za zmínku stojí třeba Gemini Nano od Google nebo Phi od Microsoftu. Tyto modely ukazují, že se mohou ve specifických případech uplatnit i nesmírně úsporné varianty.

Obrázky jsou už hned, videa trvají déle

Zatímco generování textu probíhá pomocí velkých jazykových modelů, obrázky nejčastěji vznikají v difúzních modelech. Ty fungují tak, že pak postupně zpřesňují (technicky vzato spíše „opravují“) požadovaný obraz ve stále větším rozlišení.

Nezáleží na tom, zda si přejete obrázek slona v obýváku, nebo astronauta pěstujícího zeleninu na Marsu. Spotřeba difúzního modelu bude prakticky stejná. Rozhoduje velikost modelu, požadované rozlišení a počet takzvaných difuzních kroků, které určují výslednou kvalitu obrazu.

Vygenerování obrázku ve standardní kvalitě pomocí jednoho z předních open-source modelů, Stable Diffusion 3, vyžaduje GPU podle měření zhruba 2200 joulů.

Mnohem zdlouhavější je generování obrázků pomocí nové metody multimodálních jazykových modelů, jako to nabízí třeba ChatGPT. Podrobné informace k náročnosti této metody ale zatím chybí.

Anatomie spotřeby AI

Při počítání spotřeby generativní umělé inteligence je třeba rozlišovat dvě základní fáze života každého AI modelu: trénink a inferenci.

Trénink je jednorázový, časově i finančně extrémně náročný proces, během kterého se model učí z obrovského množství dat.

Pečení videoklipů je nejdražší

Modely zaměřené na tvorbu videa jsou pak energeticky nejnáročnější. Příkladem může být open-source model CogVideoX. Jeho starší verze dokázala vytvořit zrnitou, osm snímků za sekundu rychlou animaci.

MIT Technology Review požádal o měření vědkyni Sashu Luccioni, která vede projekt „energetického skóre AI“ (AI Energy Score). Měření ukázalo, že každá taková animace vyšla na zhruba 110 tisíc joulů.

Jenže tři měsíce poté tvůrci CogVideoX představili podstatně kvalitnější model. Ten už zvládá pětisekundové video se šestnácti snímky za sekundu. Skok v kvalitě byl vykoupen více než třicetinásobným nárůstem spotřeby. Jediné pětisekundové video si vyžádá 3,4 milionu joulů. To už je skoro jedna kilowatthodina, a tedy elektřina doslova za pár korun.

Přibližně tolik si za hodinu vyžádá třeba mikrovlnná trouba s příkonem 1000 W. Komerční video modely jako Sora od OpenAI nebo Veo3 od Google jsou ještě kvalitnější a jejich energetická náročnost bude tedy velmi pravděpodobně ještě vyšší.

Jaká je osobní AI stopa?

Pojďme si tyto dílčí údaje spojit do jednoho modelového dne. Organizujete charitativní sbírku a pomocí umělé inteligence si chcete usnadnit práci. Položíte textovému modelu třeba patnáct dotazů, jak nejlépe postupovat.

Čísla výše jsou založená na měření otevřených modelů. Nelze je považovat za přesný údaj o spotřebě komerčních služeb jako ChatGPT nebo Gemini.

Provozovatelé „těch velkých“ modelů jsou pod dvojím tlakem: mají zájem na tom, aby spotřebu srazili. Snižování nákladů je vždy žádoucí, zejména když svým uživatelům účtují paušální poplatek.

Zároveň je obor ve fázi bouřlivého rozvoje a probíhá „závod ve zbrojení“ mezi jednotlivými společnostmi. Kdo nabídne schopnější a chytřejší model – i za cenu vyšší spotřeby – může získat konkurenční výhodu.

Náklady na elektřinu nejsou z hlediska technologických gigantů (zatím) zásadní položkou. Vidina, že by mohli získat na trhu de facto monopolní postavení, pro ně nepochybně bude motivací, aby na nějaký ten megawatt nehleděli.

Z kapek se rychle může stát tsunami

Zatím jsme se na spotřebu energie dívali odspodu – z hlediska jednotlivých úkolů a z pohledu jednotlivých uživatelů. Asi jako kdybychom v roce 1900 počítali, kolik benzínu spotřebuje jednotlivý automobil. To by nám nic neřeklo o tom, jaký ohromný dopad automobilová doprava bude mít v následujících dekádách na ekonomiku i celou společnost.

Nástup nové technologie „generativní AI“ je právě takový celospolečenský fenomén, jako nástup aut nebo internetu. A při účtování s jeho energetickou náročností je s tím nutné počítat.

Kolik energie spolkne ChatGPT nyní?

Podívejme se na nejpopulárnějšího chatbota, ChatGPT. Podle odhadů je dnes pátou nejnavštěvovanější webovou stránkou na světě, hned za Instagramem. V květnu ho navštívilo každý den zhruba necelých 180 milionů lidí, přičemž počet se každý měsíc o několik procent navyšuje. Kdyby tedy průměrný počet návštěv byl v současné době 200 milionů a průměrný návštěvník položil pět otázek – čísla jsme vybrali pro jednoduchost, ale řádově by měla být správná – tak by každý den musel chatbot odpovědět na miliardu požadavků.

To, jak používáme AI dnes, je jen ochutnávkou toho, co se na nás chystá. Vývoj směřuje od jednoduchého kladení otázek k mnohem komplexnějším a energeticky náročnějším aplikacím.

Rok 2025 má být rokem „AI agentů“. Ti slibují, že budou autonomně plnit úkoly za nás, aniž bychom museli dohlížet na každý jejich krok. A aniž bychom museli ručně klást otázky nebo žádat o generování obrázků a videoklipů. Modely schopné takzvaného „hlubokého uvažování“ (reasoning modely) si pro vyřešení problému samy generují mnohastránkové vnitřní monology. Někdy si dokonce mohou uživatelé a vývojáři nastavit, jaký rozpočet (shora téměř neomezený) chtějí na daný úkol vyhradit a jazykový model jej využije.

Budoucnost patří personalizovaným modelům, neustále „ukotvovaným“ na našich datech. A také hlasovým a video asistentům, kteří budou v našich zařízeních aktivní prakticky nepřetržitě. Takováto umělá inteligence nečeká na otázky uživatele, ale neustále vyvíjí vlastní činnost.

Spotřeba takového systému – kde AI agenti dávají otázky jiným AI agentům – je omezena prakticky jen kapacitou systému. Čímž se dostáváme k předpovědím Erica Schmidta: „Potřebujeme hodně energie, a potřebujeme ji rychle.“

Datacentra potřebují elektřiny jako tři Česka

Ve Spojených státech sídlí jak vývojáři, tak i servery největších firem zajišťujících běh generativní AI: Google, Microsoft, Amazon. Obsluhují samozřejmě i požadavky klientů z jiných zemí. Zpráva Lawrence Berkeley National Laboratory uvádí, že v roce 2024 spotřebovala všechna datová centra v USA přibližně 200 terawatthodin (TWh) elektřiny. Roční spotřeba České republiky v roce 2024 činila necelých 60 terawatthodin.

Požadavky amerických data center by měly dále rychle růst – a poptávku táhnou právě centra s vysokým počtem grafických jednotek určená pro AI. Zpráva přichází s odhadem, že v roce 2028 – tedy už za tři roky – by spotřeba výpočetních středisek určených primárně pro AI měla dosáhnout nějakých 240 a6 380 TWh (strana 49). To je až osminásobek současné roční spotřeby celé České republiky (domácností, podniků i dopravy dohromady).

Budoucnost je přitom opravdu nejasná a rozptyl možných scénářů vývoje veliký. Americké ministerstvo energetiky mezi dubnem a květnem letošního roku prakticky zdvojnásobilo svůj odhad nárůstu poptávky po elektřině na příští rok. A to právě kvůli rychle rostoucí poptávce provozovatelů datových center.

Je to tedy velký problém, velké firmy na něj ale nerady upozorňují. Na žádosti o konkrétní údaje ke spotřebě jejich AI modelů reagují obvykle obecnými prohlášeními o snaze o udržitelnost, případně poukazují na dílčí zlepšení efektivity nějaké konkrétní části řetězce.

Podle Lawrence Berkeley Lab nedostatek otevřenosti ze strany technologických firem znemožňuje vytvořit rozumné projekce a efektivně plánovat rozvoj energetické sítě. Růst datových center tak probíhá velmi živelně, s malým ohledem na to, co to znamená pro síť a energetiku.

Souboj AI a lidí o zdroje

Firma X patřící Elonu Muskovi například svůj problém s nedostatkem výkonu vyřešila přistavením několika desítek velkých mobilních generátorů. Jde podle nich o mobilní zařízení, jejichž provoz – pokud nestojí na jednom místě déle než 364 dní – si není nutné nechat schválit. Místní úřady je tak nemohou nechat odstavit, i když minimálně části místních obyvatel rozhodně vadí.

Takové zkratky jsou v současném závodě o dominanci v oblasti AI běžnou praxí a ukazují na napětí mezi deklaracemi o „klimatické odpovědnosti“ a zároveň potřebou pracovat na AI hned.

I v Česku a celé Evropě se spotřeba datových center obvykle schová do obecné statistické kategorie průmyslu. Například v české národní AI strategii se o této problematice vůbec nemluví. Česko se zároveň snaží získat dotaci na podporu stavby několika velkých výpočetních center specializovaných právě na AI.

AI vs lidé?

Někdy je souboj mezi stroji a lidmi spíše abstraktní myšlenka. Ale pro ty, kdo se shodou okolností vyskytují v blízkosti velkých datových center, může mít přetahování o stejné zdroje konkrétní dopady už nyní.

Velká datacentra například zabírají kapacity v přenosové síti či vodních zdrojích. Někdy do té míry, že znemožní další výstavbu v dané oblasti. Už v létě roku 2022 (tedy před uvedením ChatGPT) v americkém státě Virginia dodavatelé elektřiny varovali, že kvůli rostoucím požadavkům datových center nebudou moci k síti připojovat nové zákazníky z řad obyvatel.

Zkušenosti ze zahraničí nelze automaticky přenášet do českého prostředí. Ukazuje to ovšem, že účet za rozvoj umělé inteligence může někdy přistát na stole těch, kteří z ní přímo neprofitují. To bude platit všude a nedá se tomu zcela zabránit – ale to neznamená, že bychom si neměli udělat alespoň rámcovou představu o tom, co nás futuristické vize o AI vlastně budou stát.

Půjdou emise nahoru, nebo dolů?

Spotřeba elektřiny bude stoupat. Nejen v oboru datových center, ale zejména tam. „Takový nárůst poptávky po elektřině nebyl v USA zaznamenán od počátku tohoto století,“ uvádí loňská zpráva Goldman Sachs. „Částečně k tomu přispěje elektrifikace a reorganizace průmyslu, ale také umělá inteligence. Datová centra budou do roku 2030 spotřebovávat 8 % energie v USA, zatímco v roce 2022 to byla 3 %.“

Zvýšená poptávka po výkonu – z velké části způsobená právě nástupem generativní AI – hodila vidle do závazků velkých firem. Ty dlouhodobě mluví o omezování svých emisí CO2. Firma Google ale ve své zprávě za rok 2023 musela konstatovat, že „naše emise se zvýšily o 37 %, především kvůli zvýšené spotřebě elektřiny v našich datových centrech tam, kde nebylo možné tuto spotřebu pokrýt z obnovitelných zdrojů“.

Celková spotřeba AI ještě výrazně poroste. A to bez ohledu na to, zda se budou AI modely zlepšovat. Je to projev tzv. Jevonsova paradoxu: když se nějaká technologie zlevní nebo když se efektivita nějaké technologie zvýší, paradoxně to vede k nárůstu celkové spotřeby, nikoli k poklesu.

Aplikováno na generativní umělou inteligenci: pokud by se podařilo desetkrát snížit spotřebu elektřiny na jeden dotaz, celkový počet dotazů díky tomu vzroste více než desetkrát. Zatím se nezdá, že by měla poptávka po umělé inteligenci nějaký strop. Je omezena jen tím, kolik serverů jí dáme k dispozici a kolik jí dodáme energie.

Skutečné dopady AI na životní prostředí tak budou ovlivněné hlavně tím, jak tuto energii vyrábíme. „Hlavní cesta ke snížení environmentálního dopadu AI vede přes dekarbonizaci výroby elektřiny,“ píše například Tomáš Protivínský, analytik českého think-tanku IDEA. Upozorňuje kromě toho, že by si AI mohla na sebe – enviromentálně vzato – i vydělat. Třeba tím, že bude vědcům asistovat při vývoji nových, ekologických technologií.

Jak může AI pomoci

Mezinárodní agentura pro energii (IEA) ve své loňské zprávě uvádí několik způsobů, jak může AI omezit své dopady na životní prostředí a dokonce jak snížit emise i v dalších oborech:

- Efektivnější výroba elektřiny – Prediktivní modely mohou pomoci snížit emise elektráren lepším řízením odstávek a údržby. Energetické společnosti dlouhodobě patří mezi hlavní uživatele pokročilých superpočítačů, protože i nepatrné procentuální úspory mají časem velké dopady.

- Rozšiřování sítí – Algoritmy pro lepší návrh sítí mohou „odemknout“ zatím nevyužité kapacity. „Aplikace umělé inteligence v provozu a údržbě elektráren může do roku 2035 přinést úspory nákladů ve výši až 110 miliard USD ročně díky ušetřeným palivům a nižším nákladům,“ píše IEA.

- Inovace v energetice – AI může urychlit vývoj v řadě oblastí a na více úrovních zároveň. V medicíně už to umělá inteligence předvedla například schopností predikovat strukturu proteinů. „Mnoho oblastí energetických inovací se vyznačuje typem problémů, které umělá inteligence umí dobře řešit: velmi složité systémy, potřeba vyvážit kompromisy mezi výkonností a optimálním výsledkem a ohromné soubory dat,“ uvádí IEA.

- Lepší baterie – jedním z hlavních problémů účinného zapojení solární energie do elektrické sítě je její obtížná predikovatelnost. Umělá inteligence může nabídnout lepší předpověď počasí a také pomoci s vývojem baterií.

„Umělá inteligence je na rozcestí a hodně faktorů rozhodne o tom, jaké budou její dopady. AI by podle odhadů IEA mohla celkové globální emise z výroby energie snížit až o 4 %,“ uvádí Google ve svém aktuálním hlášení o dopadech na životní prostředí. „Proto se soustředíme na AI inovace a zároveň si hlídáme celkovou spotřebu a dopady této mocné technologie.“

To je samozřejmě techno-optimistický narativ. Pohled do historie ukazuje, že odhadovat dopady je u nových technologií zrádné. Inovace totiž mají tendenci se na sebe napojovat. Míchají se se zájmy lidí, firem a států. Někdy budou pracovat proti sobě, jindy se jejich cíle prolnou. A jednou za čas nějaká inovace spustí lavinu.

Předpovídat technologický vývoj AI si netroufáme. Víme ale poměrně přesně, kolik elektřiny v budoucnu spotřebuje: všechnu, kterou jí dáme k dispozici.